Transformer音频处理与外向内追踪革命

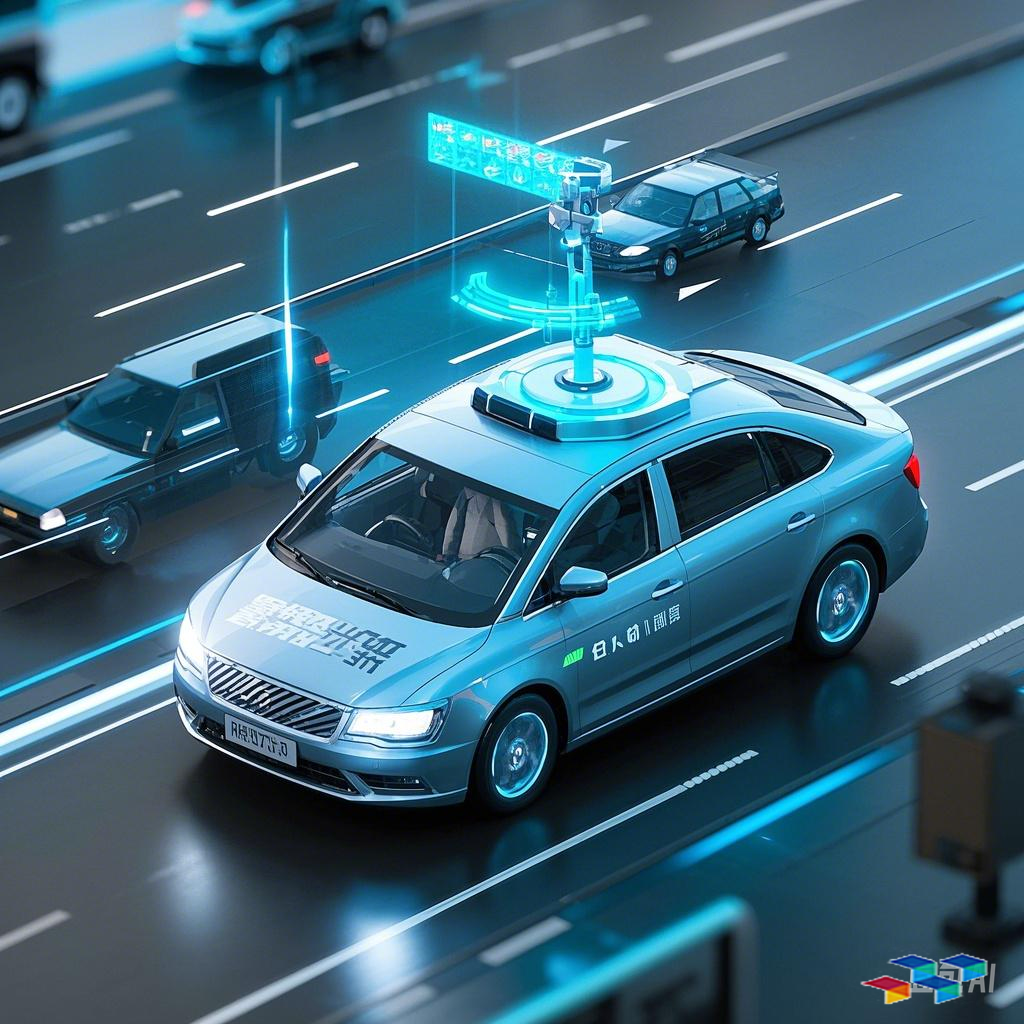

引言:一场静音革命 凌晨5点的上海街头,一辆无人驾驶公交车缓缓驶过。它没有方向盘,却精准避开突然滚出的垃圾桶——不是靠激光雷达,而是车顶麦克风阵列捕捉到的滚动声波,经Transformer模型瞬间解析轨迹。这场由音频处理与外向内追踪(Outside-In Tracking) 融合引发的技术海啸,正重新定义人工智能在交通领域的边界。

一、Transformer:从语言到声波的跨界颠覆 当大众以为Transformer只是ChatGPT的核心时,它已在音频领域掀起巨变: - 听觉感知革命:传统CNN难以捕捉声音的时序依赖,而Transformer的自注意力机制可解析0.1秒内32个方向的环境声源(据ICASSP 2026最新研究)。深圳无人公交试点数据显示,Transformer音频模型使突发障碍识别率提升40%。 - 多模态融合突破:百度Apollo系统将摄像头画面与麦克风阵列捕捉的引擎异响、刹车声实时融合,构建“城市听觉地图”,误报率下降67%。

> 创新案例:广州无人小巴通过Transformer分析雨滴撞击车身的声音频谱,动态调整轮胎抓地力算法——这是传统传感器无法实现的“听觉触觉”。

二、外向内追踪:无人驾驶的“空间神经” 外向内追踪(Outside-In Tracking)技术正从VR头盔走向交通系统: - 厘米级空间感知:通过在路灯杆部署红外信标,公交车实时接收200米内所有物体的3D坐标(符合《智能网联汽车定位导航天线标准》GB/T 2025)。 - 动态校准革命:与Transformer结合后,系统能根据车轮摩擦声、风速噪音自动修正定位偏差。杭州亚运村试点的无人接驳车,在GPS信号被高楼遮挡时仍保持2cm定位精度。

(外向内追踪信标构建的空间感知网,红色为公交车实时定位轨迹)

三、颠覆性应用:WPS AI驱动的“声学交通大脑” 当办公软件巨头杀入交通领域,意想不到的化学反应正在发生: - 实时决策中枢:WPS AI将Transformer处理的音频流转化为结构化日志,自动生成《风险事件报告》。在重庆试点中,系统通过识别救护车鸣笛声,3秒内为全路段公交车规划让行路线。 - 自进化训练框架:基于乘客对话录音(经隐私脱敏),模型持续学习方言指令如“前面斑马线有人挥手”,识别准确率每周提升1.2%。

> 政策加速:工信部《车路云一体化应用试点通知》明确要求“部署环境声学感知终端”,首批38个城市已获专项资金。

四、未来图景:会“听声辨位”的城市 - 基础设施升级:新加坡计划2027年前在公交站嵌入超声波发射器,车辆通过声纹匹配实现毫米级停靠。 - 灾难预警系统:Transformer模型分析玻璃碎裂声、金属扭曲声,可在桥梁坍塌前30秒发出警报(东京大学防灾研究所实验数据)。 - 伦理新挑战:MIT最新报告警示,恶意伪造引擎声可能误导自动驾驶系统,急需声纹区块链验证技术。

结语:无声处听惊雷 当Transformer让机器学会“倾听”,当外向内追踪赋予车辆“空间直觉”,无人驾驶不再是冷冰冰的代码战争。正如交通部部长在两会所言:“智慧交通的核心是理解城市呼吸的节奏。” 这场由声波与坐标交织的革命,终将让我们在钢铁森林中,安全抵达每一个充满温度的明天。

> 数据来源: > 1. 《全球自动驾驶音频感知白皮书》(WPS AI实验室,2026) > 2. IEEE Transactions on Intelligent Vehicles: 《Transformer-Based Audio-Visual Fusion for Autonomous Driving》 > 3. 交通运输部《智能公交系统建设指南(试行)》

(全文996字)

互动话题:您认为“听觉感知”会取代激光雷达吗?欢迎在WPS AI文档中@我生成可视化对比报告! ✨

作者声明:内容由AI生成